मनीष शर्मा-

Deepfake और AI का कमाल या हमारी सुरक्षा को खतरा? हो सकता है यह जानकारी आपको धोखा खाने से बचाये.. लुटने से बचाये. टेक्नोलॉजी जैसे जैसे advanced होती जा रही है… उससे जुड़े खतरे भी बढ़ते जा रहे हैं… इसको 2 सच्चे उदाहरणों से समझते हैं.

- चीन में पिछले दिनों एक व्यक्ति को 5 करोड़ रूपए का चूना लग गया. हुआ यह था कि उसके पास एक वीडियो call आई… वीडियो call में उसका करीबी दोस्त था, जो काफी परेशानी में दिख रहा था. दोस्त ने स्वयं को बहुत बुरी हालत में दिखाया और आर्थिक मदद मांगी.

चूँकि दोस्त सामने दिख रहा था, बात कर रहा था, इस व्यक्ति का दिल पसीज गया… और फिर इसने अपने कथित दोस्त के दिए गए account में पैसे transfer कर दिए.

बाद में पता लगा कि उस दोस्त ने कभी call किया ही नहीं था…. और इस व्यक्ति के साथ ठगी हो गई थी.

मामले की जांच पुलिस ने की… Bank transfer trace किये गए, अधिकांश पैसा recover कर लिया गया है, अपराधी भी जल्दी पकड़ा जायेगा.

- अमेरिका के Arizona में एक 15 साल की लड़की Skiing कर गई थी… अचानक से उसकी माँ को एक call आता है. Call की शुरुआत उस लड़की के रोने की आवाज़ से होती है….. माँ घबरा जाती है और अपनी बेटी से प्रश्न पूछने की कोशिश करती है.

इतने में ही एक पुरुष की आवाज़ आती है… वह कहता है कि उस महिला की बेटी उसके कब्जे में है.. और अगर 1 Million डॉलर transfer नहीं किये तो वह उसकी बेटी को मार देगा. माँ गिड़गिड़ाई… कहा कि इतने पैसे नहीं हैं…. अपहरण करने वाला 5 लाख डॉलर पर अड़ जाता है…. माँ उससे थोड़ी मोहलत मांगती है…. वो आदमी धमकी देता है कि अगर पुलिस को पता चला तो उसकी बेटी को मार देगा.

महिला अपनी एक दोस्त को फोन करती है, और उसे यह सब बताती है…वह दोस्त तुरंत उस group को call करती है जो Skiing के लिए गया था, वहाँ पता लगता है कि उस लड़की का अपहरण नहीं हुआ था.. वह तो वहाँ घूम रही थी और सुरक्षित थी.

तुरंत 911 पर call किया गया और उन्हें इस बारे में बताया गया, कि उसकी बेटी की आवाज में उन्हें call करके डराया गया और पैसे उगाहने की कोशिश की गई.

इन दोनों मामलों में आप देख सकते हैं कि कैसे एक दोस्त के चेहरे का इस्तेमाल किया गया, वहीं एक लड़की की आवाज़ का इस्तेमाल करके उसकी माँ से पैसे लेने का प्रयास किया गया.

अब आप सोच रहे होंगे कि यह कैसे हुआ होगा…. तो इसका एक ही उत्तर है… Deepfake Technology

Deepfake एक Artificial Intelligence की Implementation है… जिसकी मदद से आप किसी की भी शक्ल या बॉडी का इस्तेमाल कर सकते हैं वीडियो बनाने में. आप किसी के voice pattern को capture करके उस इंसान के जैसी हूबहू आवाज भी बना सकते हैं.

पिछले दिनों कुछ Apps भी आपने देखी होंगी… जो आपकी Pic को किसी एक्टर की Body पर लगा सकती हैं… किसी Film के वीडियो में आपकी शक्ल को एक्टर के धड़ पर लगाया जा सकता है. खैर वह बचकानी apps थी.

लेकिन कुछ समय से थोड़ी advanced apps आने लगी हैं… जो आपको बूढा दिखा सकती हैं… कुछ में आपके पूर्वजो की pic को remaster भी किया जा सकता है… छोटे छोटे वीडियो भी बनते हैं… जिनमे आपकी Still Picture का इस्तेमाल कर एक Motion वाली वीडियो बनाई जा सकती है…. जिसमें आपके Expressions भी बदल सकते हैं… और जो काफी हद तक Natural भी लगते हैं.

यह सब AI algorithm की वजह से होता है….. इन apps में Data (picture) को Encode Decode and Process करने की क्षमता होती है.

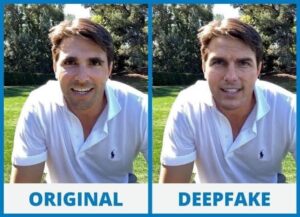

अब तो AI की सहायता से Deepfake इस सबको कई level ऊपर ले जाता है. Post में दी गई एक तस्वीर को देखिये… जिसमें एक आम इंसान है, और उसके साथ ही एक तस्वीर है Tom Cruise की…Deepfake का इस्तेमाल करके उस इंसान के चेहरे पर Tom Cruise का चेहरा Impose कर दिया गया है, और अब अगर वह कोई expression भी देगा, तो एकदम original Tom Cruise जैसा ही लगेगा.

इसमें एक आम इंसान के चेहरे के विभिन्न Points का analysis किया जाता है, फिर जो चेहरा बनाना है (Tom Cruise जैसा ) उसके हिसाब से AI algorithm चेहरे के edges को, अन्य हिस्सों को Decode Encode और Process करती है, और अंततः एकदम Tom Cruise जैसा चेहरा बना देती है.

कुछ apps में Face Filter की सुविधा भी मिलती है, जिसमें आप किसी का चेहरा भी लगा सकते हैं… ऐसा कुछ Comedians या Social Media Celebrities इसका use करते हैं…. लेकिन उसमे पता लग जाता है कि चेहरा नकली है.

लेकिन Deepfake से आप हूबहू किसी का भी चेहरा बना सकते हैं.. और इसमें काम आती है Deep Learning.

यही काम आप किसी के Voice Samples का उपयोग करके भी कर सकते हैं. मान लीजिये आपने किसी से फ़ोन पर बात की, उसने आपकी बात record कर ली.. अब वह उस Voice Sample को किसी Deepfake Voice Generator app में डाल कर आपकी Voice का clone बना सकते हैं.

आपकी Voice के उतार चढ़ाव, आपके बोलने के तरीके, pitch आदि को AI algorithm की मदद से Learn करके, उसकी cloning की जा सकती है.

जो पहली घटना आपको बताई थी… उसमे अपराधी ने Victim के दोस्त की Pics या Videos का इस्तेमाल करके (जो social media पर मिल ही जाती हैं.. सब ड़ालते ही हैं) अपने चेहरे पर उसका चेहरा Impose किया… फिर एक वीडियो call मिलाई… बातें की और यह बताया कि वह किसी समस्या में है.

Deepfake की सहायता से आप किसी से Live video Call पर भी बात कर सकते हैं… और सामने वाला आपको हूबहू अपने दोस्त जैसा ही लगेगा.

दूसरी घटना में लड़की की आवाज के samples लिए गए होंगे…. Social media से, या फ़ोन रिकॉर्डिंग से, या ऐसे ही कहीं बोलते हुए capture कर लिए होंगे… और फिर उस आवाज़ के samples को Deepfake Voice Generators में डाला गया होगा… और फिर उस लड़की की आवाज में चीखने चिल्लाने और मदद माँगने जैसे शब्द बना लिए गए होंगे.

और जब धमकी देने वाले ने call किया होगा, तो उस लड़की की आवाज की रिकॉर्डिंग background में चल रही होगी…..ताकि उसकी माँ को लगे कि उसकी बेटी वहीं Caller के पास ही है, और मदद के लिए चिल्ला रही है.. रो रही है.

पहली घटना में तो scam हो भी गया, क्यूंकि 5 करोड़ रूपए transfer कर दिए गए थे.. दूसरी घटना में महिला की दोस्त ने सीधा skiing करने गई टीम को call करके समझदारी का काम किया, और एक scam होने से बचा लिया.

अब समस्या यह है कि जैसे जैसे AI और Machine Learning उन्नत होती जायेगी, इस तरह की और समस्याएं बढ़ती जाएंगी. कुछ समय पहले तक Deepfake Videos को पहचानना आसान हुआ करता था.

1.उसमे इंसान की पलकें कम झपकती थी.. या uneven pattern हुआ करता था.

- उसमे चेहरे के edges भी uneven या Blur हुआ करते थे.

लेकिन अब App Developers ने इन कमियों को भी सुधार दिया है.. वैसे भी AI तो हमेशा learn ही करता रहता है.. Data Patterns को समझता रहता है… अब Apps में पलकें झपकना भी natural की तरह हो गया है…. वहीं Edges भी अब पहले से बेहतर हो गए हैं… आगे यह और भी Perfect System हो जायेगा.

Deepfake Technology का बहुत इस्तेमाल होना शुरू हो गया है, कई देशों में AI TV News presenters भी शुरू हो गए हैं.. जो हूबहू इंसान जैसे लगते हैं, और ख़बर पढते हैं. पिछले ही दिनों India Today ने भी एक AI news reader launch किया था.

लेकिन इस technology के नुकसान भी हैं… दो तो ऊपर ही बताये हैं.. इसके अलावा Fake News फैलाने में इसका इस्तेमाल किया जा सकता है.

Deepfake की सहायता से चुनावी campaign भी Influence किये जा सकते हैं. सोचिये क्या प्रभाव होगा voters पर अगर उनके नेता का Vulgur video आ जाए… जो Deepfake से बना हो.. लेकिन एकदम असली हो??

पुतिन के कई Fake Videos बनाये जा चुके हैं… ऐसे ही किसी बड़े राजनेता के बनाये जा सकते हैं… जो लोगों को भड़काने या दुष्प्रचार करने के काम भी कर सकते हैं…..अब आप सोच लीजिये इसका क्या क्या नुकसान हो सकता है.

ऊपर बताई घटनाओं से कैसे बचें??

Post में बताई 2 घटनाओं से आप अपने आपको बचा सकते हैं.

फिलहाल तो यही कहा जा सकता है कि अगर आपको अनजाने नम्बर या Id से video call आये, तो उस पर विश्वास ना करें.

किसी को पैसा transfer करने से पहले उससे फोन पर बात करे लें…अगर गहरा दोस्त है तो उसके परिवार में से किसी से बात कर के स्थिति को confirm करें.

आप कहीं छुट्टी पर जा रहे हैं.. या आपके बच्चे कहीं जा रहे हैं.. तो उस Social media पर ना लिखें. दूसरी घटना में यह बात अपराधी को पता थी… और उसी का लाभ उठाने का प्रयास किया गया.

आपको hiking, skiing, trekking की pics डालनी हैं… वापस लौट कर डाल लें…. क्या पता आप ऐसे इलाके में हों जहां आपसे संपर्क ना हो पाए.. और कोई अपराधी इस स्थिति का लाभ उठा कर आपके घर वालों से पैसा वसूल ले…. क्यूंकि आप से तो संपर्क नहीं हो पायेगा ना… ऐसे में घर वालों को लग सकता है कि आपका अपहरण हो गया हो.

अंत में सबसे महत्वपूर्ण बात.. Technology कितनी ही advanced हो जाए.. वह मानव के मूलभूत स्वभाव और Situational Awareness का मुकाबला नहीं कर पाएगी. कोई भी scam तभी होता है, जब आप अपने मूल स्वभाव से हट कर निर्णय लेते हैं.

आपको पता है कि shortcut से पैसा नहीं मिलता… लेकिन फिर भी लोग लालच में आ कर लाखों झोंक देते हैं.. और कोई उस पैसे को लेकर चंपत हो जाता है….. अपनी Basic Instinct को बचाये रखें… तभी टेक्नोलॉजी के दुष्प्रभावो से बच पाएंगे.